Embeddings und Vektorräume in neuronalen Netzen

Wie aus diskreten Tokens geometrische Repräsentationen werden und warum diese Vektorräume das Fundament moderner LLMs bilden

Kurzfassung: Embeddings übersetzen diskrete Symbole in kontinuierliche Vektoren. Erst dadurch können neuronale Netze Sprache, Kategorien oder andere strukturierte Daten mathematisch verarbeiten.

Weiterführende Berichte: Für den architektonischen Kontext siehe Wie funktioniert ein Transformer?. Für den übergeordneten neuronalen Unterbau siehe Neuronale Netzwerke hinter LLMs.

1. Warum überhaupt Vektoren?

Neuronale Netze können nicht direkt mit Worten wie „Bank“, „Spannung“ oder „Transformator“ arbeiten. Sie benötigen numerische Eingaben. Ein diskretes Token wird deshalb in einen kontinuierlichen Vektor übersetzt. Genau das ist die Aufgabe eines Embeddings.

Der Schritt ist entscheidend: Erst dadurch wird Sprache zu Mathematik und kann von linearen Schichten, Attention-Mechanismen und Optimierungsverfahren verarbeitet werden.

2. Embedding-Matrix und Lookup

Formal wird ein Token \(x_i\) auf einen Vektor \(e_i\) abgebildet:

\[ x_i \rightarrow e_i \in \mathbb{R}^{d} \]

Technisch wird dafür eine Embedding-Matrix \(E\) genutzt:

\[ E \in \mathbb{R}^{V \times d} \]

\(V\) ist die Vokabulargrösse, \(d\) die Embedding-Dimension. Jedes Token entspricht einer Zeile in dieser Matrix. Das eigentliche Embedding ist dann nur noch ein Lookup:

\[ e_i = E[x_i] \]

Diese scheinbar einfache Operation ist in Wahrheit eine trainierbare Projektion in einen hochdimensionalen Merkmalsraum.

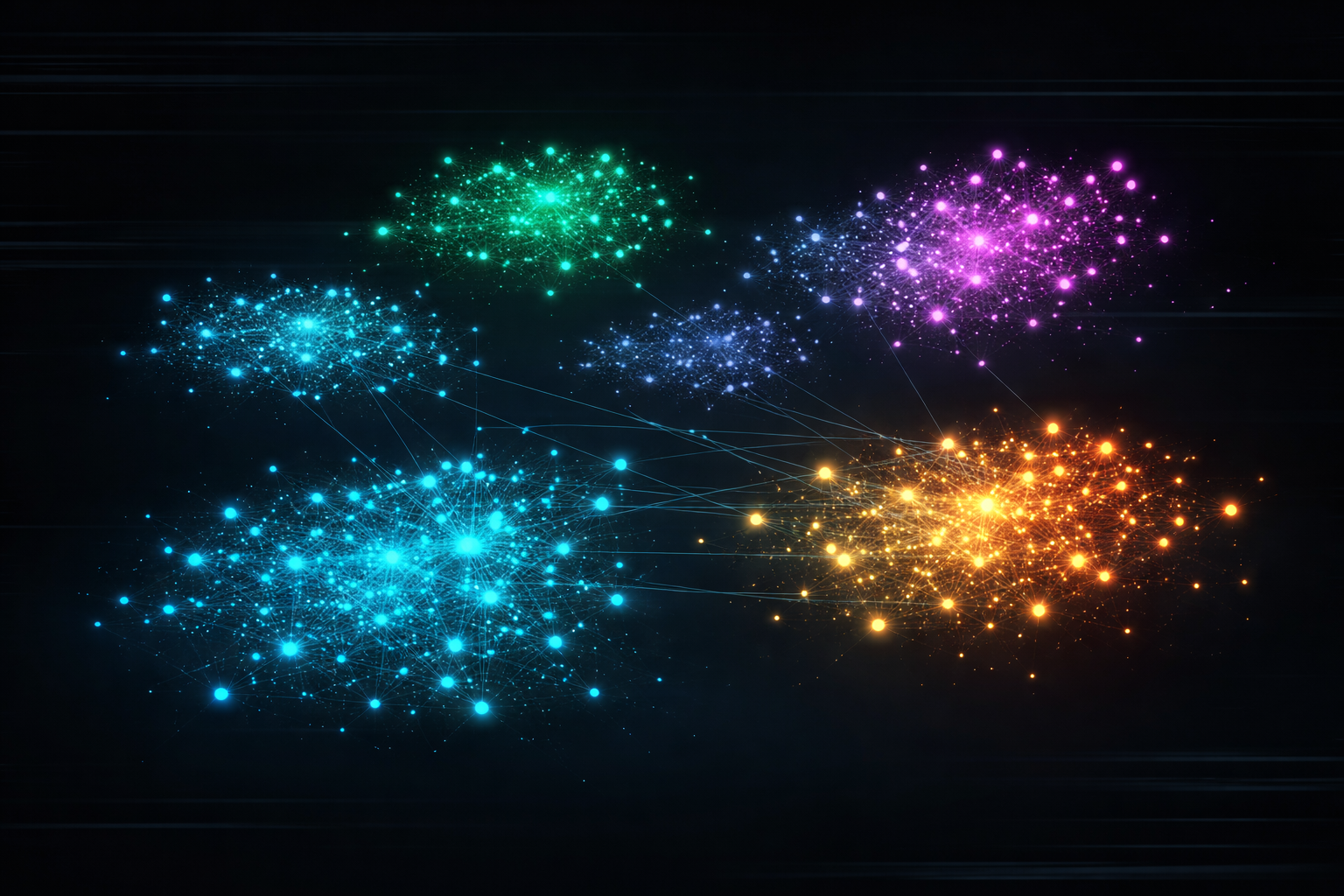

3. Geometrische Bedeutung

Die zentrale Idee lautet: Bedeutung wird in Geometrie übersetzt. Ähnliche Begriffe liegen im Vektorraum näher beieinander als unähnliche Begriffe.

Eine typische Ähnlichkeitsmessung ist die Cosine Similarity:

\[ \mathrm{sim}(a,b)=\frac{a\cdot b}{\lVert a\rVert \lVert b\rVert} \]

Damit wird nicht nur die Distanz, sondern auch die Richtung im Raum relevant. Für viele semantische Aufgaben ist genau diese Richtung aussagekräftiger als die absolute Länge eines Vektors.

Berühmte Beispiele wie

\[ \text{König} - \text{Mann} + \text{Frau} \approx \text{Königin} \]

zeigen, dass bestimmte semantische Beziehungen tatsächlich als Richtungen im Raum erscheinen können. Das ist kein magischer Effekt, sondern eine Konsequenz der gelernten Geometrie.

Wichtig ist dabei: Diese Struktur wird nicht explizit einprogrammiert. Sie entsteht als Nebenprodukt des Trainingsziels. Genau das macht Embeddings so mächtig: Das Netz formt selbst einen Raum, in dem semantisch sinnvolle Nachbarschaften und Richtungen entstehen.

4. Statische vs. kontextabhängige Embeddings

Frühere Verfahren wie Word2Vec oder GloVe geben jedem Wort genau einen festen Vektor. Das ist elegant, aber problematisch bei Mehrdeutigkeit. Das Wort „Bank“ hat je nach Kontext verschiedene Bedeutungen.

Moderne Transformer erzeugen deshalb kontextabhängige Repräsentationen:

\[ h_i = f(x_1, x_2, \ldots, x_n) \]

Das bedeutet: Die Repräsentation einer Position hängt von der gesamten Sequenz ab. Ein Token ist nicht mehr nur ein fester Punkt im Raum, sondern ein dynamischer Zustand.

Für LLMs ist genau das zentral: Sprache ist voller Mehrdeutigkeit, Referenzen und Kontextverschiebungen. Ein statischer Vektor pro Wort wäre dafür oft zu grob. Erst kontextabhängige Repräsentationen erlauben die Präzision moderner Transformer-Modelle.

5. Positionsinformation

Embeddings allein kennen keine Reihenfolge. Deshalb muss Positionsinformation explizit ergänzt werden:

\[ z_i = e_i + p_i \]

\(p_i\) kann sinusförmig, rotatorisch oder anders kodiert sein. Für das Modell ist das zentral, denn „Spannung misst Strom“ und „Strom misst Spannung“ enthalten dieselben Tokens, aber unterschiedliche Ordnung.

6. Warum so viele Dimensionen?

Typische Embeddings haben 768, 1024, 2048 oder noch mehr Dimensionen. Das wirkt zunächst überdimensioniert. Tatsächlich ist Sprache aber hochkomplex und muss viele Faktoren gleichzeitig repräsentieren:

- grammatische Rolle,

- semantische Bedeutung,

- Stil und Register,

- domänenspezifische Fachinformation,

- Kontext und Position.

Hohe Dimensionalität schafft Freiheitsgrade. Man kann sich das wie einen grossen Merkmalsraum vorstellen, in dem unterschiedliche Eigenschaften auf verschiedene Achsenkombinationen verteilt werden.

7. Wie Embeddings gelernt werden

Embeddings werden nicht separat von Hand entworfen, sondern gemeinsam mit dem restlichen Netz trainiert. Wenn das Modell das nächste Token vorhersagen soll, fliessen Gradienten bis in die Embedding-Matrix zurück.

Dadurch lernen die Vektoren genau die Struktur, die für die Gesamtaufgabe hilfreich ist. Embeddings sind also kein losgelöster Baustein, sondern ein integraler Teil des trainierten Gesamtsystems.

In grossen Sprachmodellen werden Embeddings häufig zusammen mit allen übrigen Parametern Ende-zu-Ende trainiert. Dadurch koppeln sich semantische Geometrie, Attention-Verhalten und Ausgabeverteilung eng aneinander. Das erklärt auch, warum Embeddings nie isoliert verstanden werden sollten, sondern immer im Kontext des gesamten neuronalen Netzwerks.

8. Anwendungen und Grenzen

Embeddings werden nicht nur in LLMs genutzt, sondern auch für:

- Ähnlichkeitssuche,

- Retrieval-Systeme,

- Clustering,

- Empfehlungssysteme,

- multimodale Modelle mit Text, Bild und Audio.

Eine wichtige Einschränkung bleibt: Embeddings sind verteilt kodiert und schwer direkt interpretierbar. Ein einzelner Zahlenwert hat meist keine klare Bedeutung. Aussagekräftig ist fast immer nur das Muster über viele Dimensionen hinweg.

Zusätzlich können Embeddings systematische Verzerrungen aus den Trainingsdaten übernehmen. Nähe im Raum bedeutet deshalb nicht automatisch „Wahrheit“, sondern spiegelt statistische Muster des Trainingsmaterials wider.

9. Ingenieurssicht

Ingenieurssicht: Embeddings kann man als Zustandstransformation von diskreten Symbolen in einen kontinuierlichen Signalraum lesen.

Aus elektrotechnischer Sicht ist das sehr vertraut: Ein System arbeitet oft nicht direkt auf Rohsymbolen, sondern auf transformierten Zustandsgrössen oder Merkmalsvektoren. Embeddings übernehmen genau diese Rolle.

Auch der Begriff des Merkmalsraums ist Ingenieuren aus Signalverarbeitung, Zustandsraummodellen und statistischer Mustererkennung vertraut. Das Neue an LLMs ist weniger das Grundprinzip als die enorme Skalierung und die dynamische Kontextabhängigkeit.

10. Fazit

Embeddings sind das Fundament moderner Sprachmodelle. Sie wandeln diskrete Tokens in Vektoren um, machen semantische Beziehungen geometrisch fassbar und liefern den Startpunkt für die gesamte weitere Verarbeitung im neuronalen Netz.

Ohne Embeddings gäbe es keine Attention, keine kontextabhängigen Repräsentationen und letztlich keine leistungsfähigen LLMs in ihrer heutigen Form.

Wenn du als Nächstes sehen willst, wie diese Vektoren im Modell weiterverarbeitet werden, lies Wie funktioniert ein Transformer?. Für den allgemeinen Zusammenhang zwischen Embeddings, Gewichten, Aktivierungen und Training passt Neuronale Netzwerke hinter LLMs.

Autor: Ruedi von Kryentech

Erstellt am: 14.04.2026 · Zuletzt aktualisiert: 14.04.2026

Fachlicher Stand zum Zeitpunkt der letzten Aktualisierung.