ニューラルネットワークを理解する

基礎・手計算・LLMとの関係

重み・バイアス・活性化関数から誤差逆伝播、ディープラーニング、トランスフォーマーまで

要約: 本稿はニューラルネットを基礎から説明する。まず具体的な手計算と活性化関数、次にディープラーニング・トランスフォーマー・LLMへの移行を扱う。

関連記事: アーキテクチャの詳細はトランスフォーマーの仕組み。入力記号のベクトル表現はニューラルネットにおける埋め込みとベクトル空間。

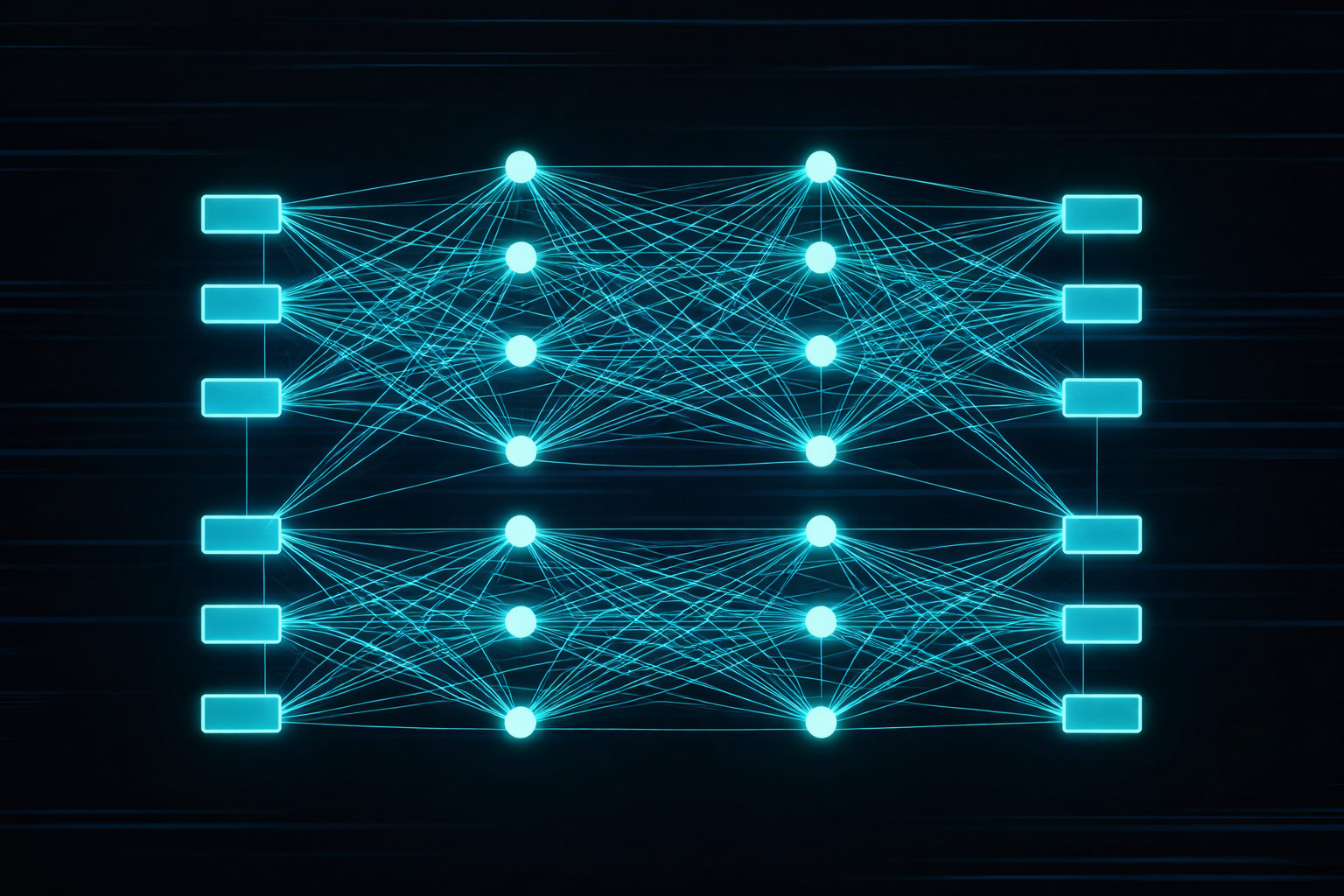

1. ニューラルネットワークとは

ニューラルネットは入力を出力へ写すパラメータ付き関数 \(f_{\theta}\) である。 パラメータ \(\theta\) は手で決めずデータから学習される。

\[ y = f_{\theta}(x) \]

歴史的には生物学的ニューロンに着想を得たが、技術的には重み付き和・非線形関数・多数の積層からなる計算系である。

2. 線形層・重み・手計算

多くのネットの基本ブロックはアフィン変換である:

\[ z = Wx + b \]

\(W\) は重み行列、\(b\) はバイアスベクトル。非線形性がなければネット全体は結局1つの線形写像に縮退する。 表現力は活性化関数との相互作用から生まれる。

LLMではそのような行列が随所に現れる:埋め込み、アテンションの射影、フィードフォワード、語彙への出力射影など。

1ニューロンを手で計算する

人工ニューロンはまず入力の重み付き和を計算しバイアスを加える。 その結果は手計算で完全に追える中間値となる。

\[ z = w_1x_1 + w_2x_2 + b \]

\(x_1 = 2\), \(x_2 = 3\), \(w_1 = 0.5\), \(w_2 = -1.0\), \(b = 0.2\) とすると:

\[ z = 0.5 \cdot 2 + (-1.0) \cdot 3 + 0.2 = 1 - 3 + 0.2 = -1.8 \]

この \(z\) はしばしばプレ活性化または正味入力と呼ばれ、活性化関数が次層へどう渡すかを決める。

2ニューロンからなる小さな層

1つの層は同じ入力を見る複数のニューロンからなり、異なる重みとバイアスで複数の並列出力を生む。

\(x=\begin{bmatrix}1\\2\end{bmatrix}\), \(W=\begin{bmatrix}1.0 & 0.5\\-0.5 & 2.0\end{bmatrix}\), \(b=\begin{bmatrix}0.1\\-0.2\end{bmatrix}\) のとき:

\[ z = Wx+b = \begin{bmatrix} 1.0\cdot1 + 0.5\cdot2\\ -0.5\cdot1 + 2.0\cdot2 \end{bmatrix} + \begin{bmatrix} 0.1\\ -0.2 \end{bmatrix} = \begin{bmatrix} 2.1\\ 3.3 \end{bmatrix} \]

これは行列表記のコンパクトな形を示す。中身は乗算・加算・バイアスシフトという同じ初等演算である。

3. 数値例による活性化関数

活性化関数が豊かな特徴空間に必要な非線形性を与える。 古典的にはシグモイド、tanh、ReLU。現代のトランスフォーマーではGELUやSwiGLUが主役になることが多い。

\[ y = \sigma(Wx+b) \]

工学的には:線形の連鎖は線形系しかモデル化できない。非線形性によって飽和・閾値挙動・複雑な結合・高次元近似が可能になる。

ReLUという単純な特性曲線

ReLUは \(\mathrm{ReLU}(z)=\max(0,z)\) で負の値を0にクリップする。 中間値 \(z=-1.8\) では \(\mathrm{ReLU}(-1.8)=0\)。

正の値 \(z=2.1\) では信号はそのまま通る:\(\mathrm{ReLU}(2.1)=2.1\)。 工学的には負領域を抑えた単純な非線形特性とみなせる。

確率として読む滑らかな写像としてのシグモイド

シグモイドは任意の入力を0から1の範囲へ写し、確率として解釈しやすい出力にする。形式的には:

\[ \sigma(z)=\frac{1}{1+e^{-z}} \]

\(z=-1.8\) では \(\sigma(-1.8)=\frac{1}{1+e^{1.8}}\approx \frac{1}{1+6.05}\approx 0.142\)。 \(z=2.1\) では \(\sigma(2.1)=\frac{1}{1+e^{-2.1}}\approx \frac{1}{1+0.122}\approx 0.891\)。

原点中心の活性化としてのtanh

\(\tanh(z)\) はシグモイドに似るが出力は-1から1で原点中心であり、正負の活性を対称的に表しやすい。

\[ \tanh(z)=\frac{e^z-e^{-z}}{e^z+e^{-z}} \]

\(z=2.1\) では \(\tanh(2.1)\approx 0.97\)、\(z=-1.8\) では \(\tanh(-1.8)\approx -0.95\)。 大きな振幅を符号を失わずに有界領域へ圧縮する様子が分かる。

4. なぜ多層か

深いネットは階層的な表現を学習する。下位層は単純なパターン、上位層は合成された構造を捉える。言語処理では例えば:

- 下位層:局所的なトークンパターンと構文、

- 中位層:関係と構造、

- 上位層:より抽象的な意味またはタスク依存の特徴。

そのためLLMはディープラーニングと呼ばれる。性能は単一層ではなく、多数の変換の積み重ねから生まれる。

5. 誤差逆伝播と学習

ネットは予測と正解の誤差を計算し、連鎖律で後方へ伝播させて学習する。

\[ \frac{\partial L}{\partial \theta} \]

これらの勾配は誤差を小さくするためにパラメータをどう動かすべきかを示す。誤差逆伝播なしに現代規模のネットを訓練することは実質不可能である。

技術的には各層は順方向の写像だけでなく誤差伝播への寄与も与える。連鎖律が部分項を結ぶ。深いネットでは勾配の流れ・残差接続・正規化が重要になるのはこのためである。

6. 実務での最適化

素朴な勾配降下法は次の形である:

\[ \theta_{t+1} = \theta_t - \eta \nabla_{\theta}L \]

LLMでは通常AdamまたはAdamWに加え、ウォームアップ、学習率スケジュール、混合精度、勾配クリッピング、分散訓練が用いられる。 ネットは数学的对象であると同時に複雑な最適化問題でもある。

工学的には、資源制約下での強非線形系の同定に近い。数値・安定性・ハードウェアも結果に大きく影響する。

7. 手設計ではなく表現学習

多くの古典的MLパイプラインとの大きな違いは、ニューラルネットが特徴そのものを学ぶことである。 手作り特徴ベクトルの代わりに、目的関数への最適化から有用な表現が生まれる。

LLMでは出力重みだけでなく埋め込み・内部状態・アテンション射影・意味構造が共同で学習される。 現代の言語モデルが古典的NLPより柔軟な主因の一つである。

8. LLMになるまで

LLMでは入力はトークン列である。トークンはベクトル化され、多数のトランスフォーマー層を経て、最後に語彙へ射影される。典型的な目的は:

\[ P(x_t \mid x_1, \ldots, x_{t-1}) \]

したがってLLMは深いニューラルネットであり、言語構造をモデル化して次のトークンをできるだけ正確に予測するという具体的な役割を持つ。

9. 特定のアーキテクチャとしてのトランスフォーマー

トランスフォーマーは現代LLMを駆動する具体的アーキテクチャである。次を組み合わせる:

- 入力表現としての埋め込み、

- 文脈依存の結合のための自己注意、

- 非線形特徴抽出のためのフィードフォワード、

- 安定化のための残差接続とレイヤー正規化。

重要:LLMは単なる「テキスト上の統計」ではなく、数十億パラメータを持つ大規模トランスフォーマーでもある。

ここから専門記事に分岐する:アーキテクチャはトランスフォーマーの仕組みで詳述し、 入力表現と意味の幾何はニューラルネットにおける埋め込みとベクトル空間で深掘りする。

10. 電気工学との関係

工学的視点: ニューラルネットはパラメータ化された多段信号処理系として読みやすい。

各層は入力ベクトルを出力ベクトルへ写す。ネットは線形ブロック・非線形要素・ゲイン・正規化・最適化を通じたフィードバックを伴う信号鎖に似る。

状態空間・近似・システム同定・安定性・ハードウェア加速は電気工学者に馴染み深い。主な違いはデータ量・スケール・高次元特徴空間である。

11. まとめ

LLMを理解するにはニューラルネットを理解する必要がある。言語モデルは切り離されたAI概念ではなく、巨大なテキストで最適化された重みを持つ深いネットである。

トランスフォーマー・アテンション・埋め込み・出力ロジットは、同じ原則の異なるブロックである: 訓練されたニューラルネットが言語上の複雑な関数を近似する。

1ニューロンの手計算・小さな層の行列計算・ReLU・シグモイド・tanhの効果が分かれば、以降の専門トピックの基礎はすでに揃っている。

実践的な次の一歩としてトランスフォーマーの仕組みと ニューラルネットにおける埋め込みとベクトル空間を推す。

著者: Ruedi von Kryentech

作成: 2026年4月14日 · 最終更新: 2026年4月14日

最終更新時点の技術的内容。